Die Clusteranalyse ist ein exploratives Verfahren. Das heißt, hier darf mit den Daten und dem Verfahren „gespielt“ werden. Verschiedene Methoden dürfen ausprobiert werden und die Ergebnisse verglichen und gegeneinander abgewogen werden. In diesem Blogartikel gebe ich Dir einen Überblick über die verschiedenen Methoden und Einstellungsmöglichkeiten.

Ziel der Clusteranalyse ist es meist, eine inhaltlich sinnvolle Clusterlösung zu finden. Oft wird im Anschluss mit dieser Clusterlösung als Gruppierung weiter gearbeitet.

Verschiedene Cluster-Algorithmen

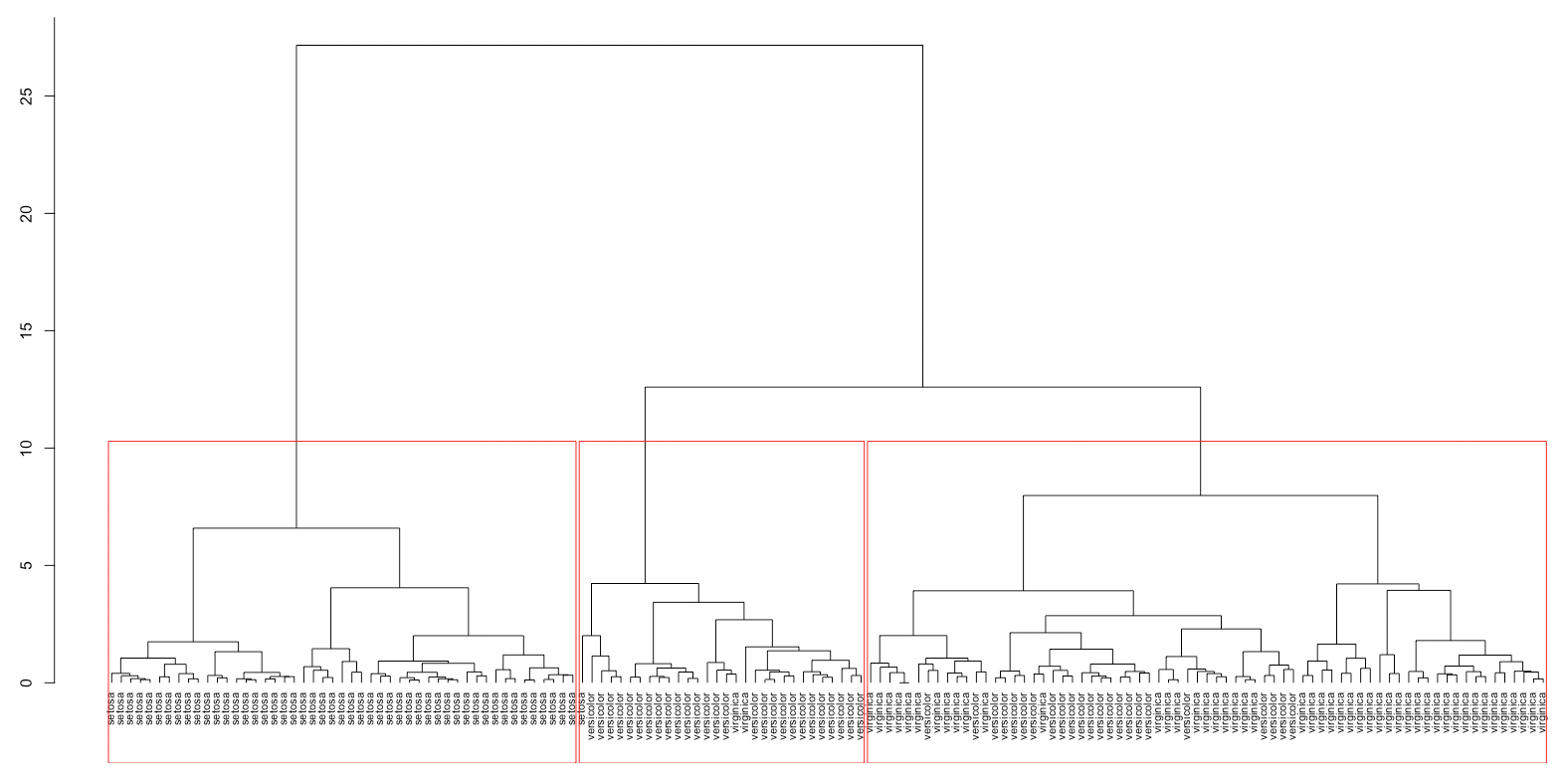

Ein fusionierender Algorithmus ist z.B. die hierarchische Clusteranalyse. Hier sind zu Beginn alle Objekte einzelne Cluster. Schritt für Schritt werden die Cluster dann zu größeren Clustern zusammen gefasst. Diese schrittweise Zusammenfassung lässt sich in einem Dendrogramm veranschaulichen. Das Dendrogramm kann dazu genutzt werden, eine passende Clusterlösung auszuwählen.

Die K-Means-Clusteranalyse ist ein partitonierendes Verfahren. Hier wird zunächst die Anzahl der Cluster vom Anwender vorgegeben. Der Algorithmus startet dann mit einer (zufälligen) Zuordnung der Objekte zu diesen Clustern. Schritt für Schritt werden die Objekte dann anderen Clustern zugeordnet und so versucht, die Clusterlösung zu optimieren.

Du willst mehr Durchblick im Statistik-Dschungel?

Verschiedene Distanzen und Fusionierungsverfahren

Häufig verwendete Distanzmetrik für metrische Variablen ist die Euklidische Distanz. Bei dichotomen Kriterien wird z.B. der Jaccard-Koeffizient verwendet. Aber auch andere Maße sind gängig.

Als Fusionierungskriterien hat sich Ward bewährt. Vor allem dann, wenn es keine Ausreißer gibt und die Cluster ungefährt gleich groß sein sollen. Zu ähnlichen Ergebnissen kommt oft Complete Linkage. Single Linkage führt als Fusionierungskriterium oft zu einzelnen kleinen Clustern oder kann gut zur Identifikation von Ausreißern eingesetzt werden.

Das solltest Du bei der Clusteranalyse noch beachten

- Wähle die Merkmale, anhand derer Du clusterst, inhaltlich sinnvoll aus.

- Standardisiere metrische Merkmale, wenn sie nicht alle auf der gleichen Skala gemessen wurden.

- Bereinige Ausreißer.

- Wähle die Anzahl der Cluster nach inhaltlichen Gesichtspunkten aus.

- Robustheitscheck: Rechne mehrere Clusteranalysen mit unterschiedlichen Methoden (hierarchisch, K-Means, verschiedene Distanzmaße, verschiedene Fusionierungskriterien) und vergleiche die Ergebnisse.

Du willst mehr Durchblick im Statistik-Dschungel?

Backhaus K, Erichson B, Plinke W, Weiber R (2011) Multivariate Analysemethoden. Eine anwendungsorientierte Einführung. 13. Auflage. Berlin: Springer.

Ich bin Statistik-Expertin aus Leidenschaft und bringe Dir auf leicht verständliche Weise und anwendungsorientiert die statistische Datenanalyse bei. Mit meinen praxisrelevanten Inhalten und hilfreichen Tipps wirst Du statistisch kompetenter und bringst Dein Projekt einen großen Schritt voran.